विषय

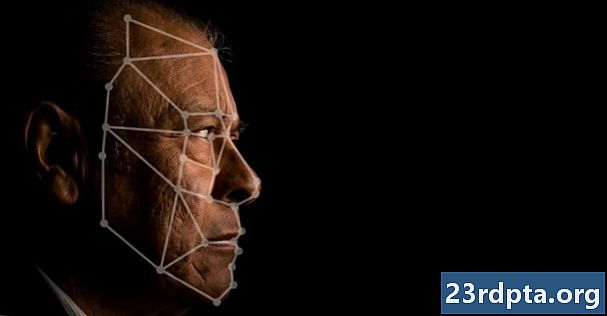

गहरी सामग्री उन लोगों के बीच अराजकता का निर्माण कर रही है जो इस विचार के साथ बड़े हुए हैं कि देखकर विश्वास हो रहा है। कभी-कभी कुछ होने के निर्विवाद सबूत माने जाने वाले फ़ोटो और वीडियो, अब जनता द्वारा पूछताछ किए जा रहे हैं। बराक ओबामा द्वारा राष्ट्रपति ट्रम्प को "कुल और पूर्ण डुबकी ****" कहने के आश्चर्यजनक यथार्थवादी वीडियो को खोजने के बाद यह उम्मीद की जानी चाहिए, यह एक गहरी रचना नहीं है।

गहरी सामग्री उन लोगों के बीच अराजकता का निर्माण कर रही है जो इस विचार के साथ बड़े हुए हैं कि देखकर विश्वास हो रहा है।

एडगर ग्रीवांसइसमें शामिल तकनीक भौहें उठा रही है और सवाल पैदा कर रही है, यही कारण है कि हम आपको यहां यह बताने के लिए कि यह क्या है, यह कैसे काम करता है, और अगर वास्तव में चिंता करने का एक कारण है, तो आप इसे पूरा कर सकते हैं।

डीपफेक क्या है?

डीपफेक एक AI (कृत्रिम बुद्धिमत्ता) तकनीक है जो सामग्री बनाने या हेरफेर करने के लिए मशीन लर्निंग का उपयोग करती है। इसका उपयोग अक्सर मोंटाज बनाने या दूसरे के शीर्ष पर किसी व्यक्ति के चेहरे को उभारने के लिए किया जाता है, लेकिन इसकी क्षमताएं इससे कहीं अधिक हैं। इस तकनीक में बहुत सारे अन्य अनुप्रयोग हैं। इनमें ध्वनि, आंदोलन, परिदृश्य, जानवर और बहुत कुछ जोड़-तोड़ या निर्माण शामिल हैं।

डीपफेक कैसे काम करता है?

डीपफेक सामग्री एक मशीन लर्निंग तकनीक के माध्यम से बनाई गई है जिसे जीएएन (जेनेरिक एडवरसरी नेटवर्क) के रूप में जाना जाता है। गण दो तंत्रिका जाल का उपयोग करते हैं: एक जनरेटर और एक विभेदक। ये लगातार एक दूसरे के खिलाफ प्रतिस्पर्धा कर रहे हैं।

जनरेटर एक यथार्थवादी छवि बनाने की कोशिश करेगा, जबकि विवेचक यह निर्धारित करने का प्रयास करेगा कि यह नकली है या नहीं। यदि जेनरेटर भेदभाव करने वाले को मूर्ख बनाता है, तो विवेकशील एक बेहतर न्यायाधीश बनने के लिए एकत्रित जानकारी का उपयोग करता है। इसी तरह, अगर डिस्क्रिमिनेटर यह निर्धारित करता है कि जनरेटर की छवि नकली है, तो जनरेटर नकली छवि बनाने में बेहतर होगा। कभी न खत्म होने वाला चक्र तब तक जारी रह सकता है जब तक कि कोई चित्र, वीडियो या ऑडियो अब मानवीय दृष्टिकोण के लिए बिल्कुल नकली न हो।

मूल

पहले गहरे वीडियो स्पष्ट रूप से अश्लील थे!

एडगर ग्रीवांसपहले गहरे वीडियो स्पष्ट रूप से अश्लील थे! विशेष रूप से, पोर्न अभिनेत्रियों के बारे में सेलिब्रिटी के चेहरे को देखना आम बात थी। अन्य मजेदार आविष्कारों के बीच निकोलस केज मेम भी लोकप्रिय थे।

डीपफेक शब्द 2017 में इस तकनीक का पर्याय बन गया, धन्यवाद एक रेडिट उपयोगकर्ता के लिए जो "डीपफेक" के नाम से गया। उपयोगकर्ता को अब प्रतिबंधित किए गए अन्य लोगों द्वारा शामिल किया गया था आर / deepfakes सब्रेडिट, जहां उन्होंने अपनी रचनाओं को दुनिया के साथ साझा किया।

जेनरेटरी एडवरसरी नेटवर्क का असली निर्माता इयान गुडफेलो है। अपने सहयोगियों के साथ, उन्होंने 2014 में मॉन्ट्रियल विश्वविद्यालय के लिए अवधारणा पेश की। वह तब Google के लिए काम करने के लिए चले गए, और वर्तमान में ऐप्पल के साथ कार्यरत हैं।

खतरे

गलत हाथों में, निकोलस केज मेमेस की तुलना में डीपफेक निर्माण का उपयोग बहुत अधिक गलत तरीके से किया जा सकता है।

एडगर ग्रीवांसजबकि सामग्री हेरफेर कोई नई बात नहीं है, इसके लिए गंभीर कौशल की आवश्यकता होती है। नकली सामग्री बनाने के लिए आपको एक शक्तिशाली कंप्यूटर और वास्तव में अच्छे कारण (या बहुत अधिक खाली समय) की आवश्यकता थी। FakeApp जैसी डीपफेक क्रिएशन सॉफ्टवेयर मुफ्त, खोजने में आसान है, और इसके लिए बहुत अधिक कंप्यूटर शक्ति की आवश्यकता नहीं है। और क्योंकि यह सभी काम अपने दम पर करता है, इसलिए आपको वास्तविक रूप से वास्तविक गहन मीडिया बनाने के लिए एक कुशल संपादक होने की आवश्यकता नहीं है।

यही कारण है कि आम जनता, मशहूर हस्तियां, राजनीतिक संस्थाएं और सरकारें गहरे आंदोलन की चिंता कर रही हैं। गलत हाथों में, निकोलस केज मेमेस की तुलना में डीपफेक निर्माण का उपयोग बहुत अधिक गलत तरीके से किया जा सकता है। किसी को नकली समाचार बनाने या वीडियो साक्ष्य को कम करने की कल्पना करें। आप समस्या में नकली और बदला लेने वाला पोर्न जोड़ सकते हैं। चीजें गड़बड़ हो सकती हैं असली जल्दी।

डीपफेक सामग्री के बारे में चिंता करने का एक और कारण यह है कि महत्वपूर्ण व्यक्तित्व पिछले कार्यों से भी इनकार कर सकते हैं। क्योंकि डीपफेक वीडियो इतने वास्तविक लगते हैं, कोई भी दावा कर सकता है कि एक वास्तविक क्लिप एक डीपफेक है।

यह भी पढ़े: नैतिकता और एआई की जटिलताएं

कोई उपाय खोजना

जबकि वास्तविक के बहुत करीब, एक प्रशिक्षित आंख अभी भी एक नकली वीडियो पर ध्यान दे सकती है। चिंता यह है कि भविष्य में कुछ बिंदु पर हम अंतर बताने में सक्षम नहीं हो सकते हैं।

ट्विटर, पोर्नहब, रेडिट और अन्य ने इस तरह की सामग्री से छुटकारा पाने की असफल कोशिश की है। अधिक आधिकारिक पक्ष पर, डीएआरपीए (डिफेंस एडवांस्ड रिसर्च प्रोजेक्ट्स एजेंसी) डीपफेक स्पॉट करने का एक तरीका बनाने के लिए अनुसंधान संस्थानों और कोलोराडो विश्वविद्यालय के साथ काम कर रहा है।

डीपफेक वीडियो का मुकाबला करने के लिए सबसे अच्छा हम अधिक चौकस और कम भोला होना है।

एडगर ग्रीवांसजब तक हमारे पास ऐसे सॉफ़्टवेयर हैं जो इस तरह के वीडियो में अनियमितता को प्रदर्शित कर सकते हैं, हम जो सबसे अच्छा कर सकते हैं वह अधिक चौकस और कम भयावह हो सकता है। वीडियो, छवि या ऑडियो वास्तविक होने से पहले अपना शोध करें। यह कुछ ऐसा है जो हमें पहले से ही करना चाहिए था, वैसे भी।

लोकप्रिय डीपफेक सामग्री

जॉर्डन पील इस वीडियो को एक साथ रखने के लिए बज़फीड में शामिल होता है, जो चेतना पैदा करने के लिए है।

ऑनलाइन हेरफेर विशेषज्ञ क्लेयर वार्डले हमें दिखाते हैं कि वीडियो के पहले 30 सेकंड के लिए एडेल के रूप में दिखाई देने से ये वीडियो कितने यथार्थवादी लग सकते हैं। द न्यूयॉर्क टाइम्स का यह वीडियो हमें इस विषय पर बहुत जानकारी देता है।

वॉचमोज़ो ने सबसे लोकप्रिय डीपफेक वीडियो में से कुछ की सूची को क्यूरेट किया है। यह बहुत सारे बेहतरीन उदाहरणों के साथ एक मजेदार वीडियो है।

क्या आप डीपफेक वीडियो के परिणामों के बारे में चिंतित हैं? यह निश्चित रूप से एक विषय है जिसे हमें ध्यान में रखना चाहिए, जबकि समाधान खोजने पर भी काम करना चाहिए।